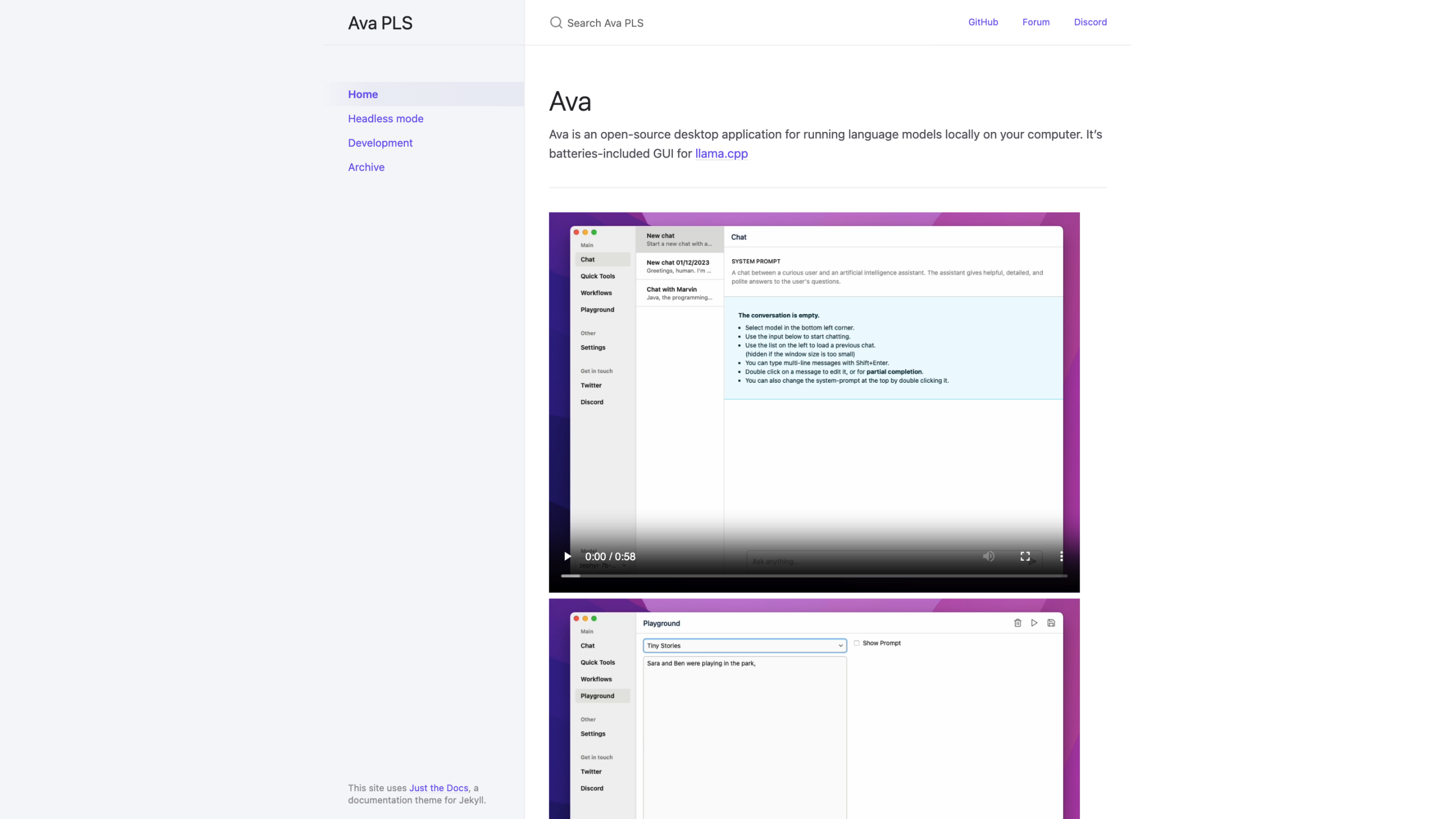

Ava — это настольное приложение с открытым исходным кодом для локального запуска языковых моделей на вашем компьютере. Он предоставляет графический пользовательский интерфейс (GUI), встроенный в батареи, построенный вокруг llama.cpp, что позволяет пользователям запускать языковые модели в автономном режиме с удобным локальным рабочим процессом. В проекте используются Zig и C++ (llama.cpp), SQLite для обработки данных и современный интерфейсный стек (Preact, Preact Signals, Twind) для адаптивного пользовательского интерфейса. Ava может быть загружен в виде готовых артефактов или построен из источника, включая опцию безголового режима для использования без графического интерфейса.

Как работает Ava

- Локальное выполнение модели: запустите языковые модели непосредственно на компьютере, не требуя облачного доступа.

- Рабочий процесс на основе GUI: удобный интерфейс рабочего стола для настройки и выполнения моделей, управления сессиями и просмотра выходов.

- Параметры сборки: Загрузите предварительно построенные двоичные файлы или создайте из источника с помощью Zig; поддерживает стандартные команды сборки.

- Режим без головы: используйте -Dheadless=true для запуска Ava без GUI для автоматизации или задач в стиле сервера.

Начало работы

- Скачать или построить Ava. Получите готовые артефакты из GitHub Actions или постройте их локально.

- Запуск Авы. Откройте GUI, чтобы начать настройку моделей, выбор весов и выдачу подсказок.

- Запускайте модели локально. Выполняйте задачи вывода непосредственно на вашем компьютере, с результатами, отображаемыми в приложении.

- Факультативный безголовый бег. Создайте с помощью -Dheadless=true для работы Ava в безголовом режиме для сценариев и автоматизации.

Технический стек

- Язык программирования Zig

- C++ (llama.cpp) для выполнения модели

- SQLite для управления данными

- Обсуждение Preact, Preact Signals, Twind

Безопасность и лицензирование

- Ava лицензирована MIT и предназначена для локального, автономного использования языковых моделей. Уважайте лицензии моделей и конфиденциальность данных при обработке запросов и выходов.

Основные характеристики

- Локальное исполнение языковых моделей с GUI

- Проект с открытой лицензией MIT

- Построенный вокруг llama.cpp для эффективного вывода на устройстве

- Zig-система сборки с поддержкой zig build run и zig build run -Dheadless=true

- Интегрированный интерфейсный стек (Preact, Preact Signals, Twind) для адаптивного пользовательского интерфейса

- SQLite для легкого управления локальными данными

- Предустановленные артефакты или исходные тексты из GitHub Actions

- Режим без головы для автоматизации и сценариев