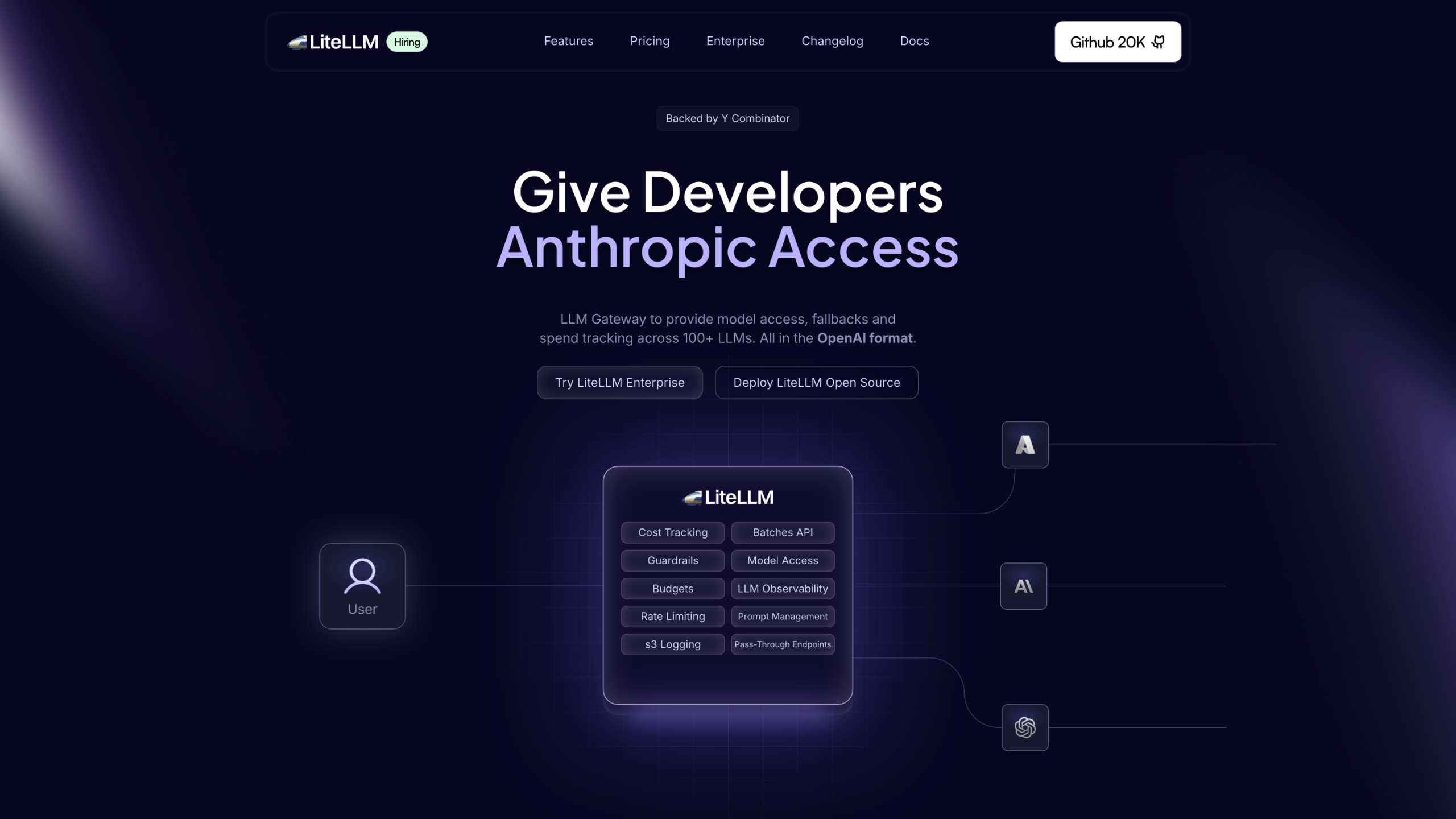

ЛайтЛЛМ это платформа, которая упрощает доступ к модели, отслеживание расходов и резервные копии для 100+ LLM-провайдеров в формате OpenAI. Он предлагает как развертывание с открытым исходным кодом, так и развертывание Enterprise, с инструментами для управления доступом разработчиков, бюджетами, ограничениями скорости и наблюдаемостью, обеспечивая бесшовную интеграцию с основными поставщиками облачных вычислений и ИИ (OpenAI, Azure, Bedrock, GCP и т. Д.). Решение предназначено для платформенных команд для безопасного предоставления LLM-доступа многим разработчикам и проектам с надежными механизмами отслеживания затрат, управления и резервного копирования.

Как LiteLLM Работы

- Обеспечивает единый шлюз для 100+ LLM-провайдеров в формате OpenAI-совместимости.

- Централизует отслеживание расходов, бюджеты и лимиты ставок между поставщиками.

- Включает атрибуцию затрат по ключу/пользователю/команде/оргам и возможность наблюдения на основе журнала.

- Поддерживает OpenAI-совместимые подсказки и может форматировать подсказки для различных размещенных моделей (модели HF и другие).

- Обеспечивает доступ к LLM через режимы развертывания, подходящие для сред OSS или Enterprise (облачные или автономные).

- Включает функции управления, такие как управление подсказками, ограждения и готовая к аудиту регистрация.

Особенности

- OpenAI-совместимый LLM доступ через 100+ провайдеров (OpenAI, Azure, Bedrock, GCP и т.д.).

- Отслеживание расходов с указанием на основе тегов ключа/пользователя/команды/орга и автоматической регистрации в S3/GCS/etc.

- Бюджеты и лимиты ставок для обеспечения соблюдения границ использования и контроля затрат.

- LLM Откаты для обеспечения высокой доступности путем переключения поставщиков, когда это необходимо.

- Тщательно интегрированные лесозаготовки и наблюдаемость (Langfuse, OTEL, Prometheus и др.).

- Оперативное управление и оперативная поддержка форматирования различных моделей.

- Функции предприятия: JWT Auth, SSO, журналы аудита, пользовательские SLA и опции on-prem/self-hosted.

- Опции развертывания OSS и Cloud для гибкого хостинга.

- Простой в использовании шлюз / прокси-слой для упрощения доступа разработчиков во многих моделях.

- Расходы связаны с ключами / пользователями / командами / организациями с автоматической отчетностью о расходах.

Как начать работу

- Выберите Open Source или Enterprise.

- Подключите провайдеров LLM (OpenAI, Azure, Bedrock и т. д.).

- Определите политику доступа для разработчиков и команд.

- Включите отслеживание расходов и бюджеты, а затем отслеживайте использование через панели инструментов.

- Используйте шлюз для маршрутизации подсказок к соответствующей модели/поставщику с единой телеметрией.

Случаи использования

- Большим организациям нужен доступ к новейшим LLM для нескольких команд.

- Финтех, страхование и потребительские приложения, требующие стандартизированного доступа к LLM, контроля затрат и управления.

- Команды, нуждающиеся в быстрой адаптации новых моделей без переделки обработки ввода/вывода.

Безопасность и соблюдение

- Корпоративная аутентификация, аудит и функции соответствия.

- Четкое отделение доступа разработчиков от производственных данных с надежной регистрацией.

- Управление затратами для предотвращения непредвиденных расходов и обеспечения соблюдения бюджетов.

Основные преимущества

- Централизованный, совместимый LLM-доступ для многих провайдеров.

- Отличная атрибуция затрат и видимость расходов.

- Надежные ограждения и оперативное управление для поддержания качества и безопасности.

- Гибкие варианты развертывания (OSS или Enterprise, облачные или автономные).

Цены и планы

- Open Source: бесплатно с функциями OSS.

- Предприятие: индивидуальные цены с SLA, безопасность и поддержка.

Отзывы (иллюстративные)

- Netflix использует LiteLLM, чтобы предоставить разработчикам доступ к Day 0 LLM, сокращая время выпуска и избегая преобразования данных между поставщиками.

- Lemonade подчеркивает упорядоченное управление несколькими LLM и уменьшенную операционную сложность.

- RocketMoney отмечает стандартизированную регистрацию и аутентификацию моделей, что позволяет быстро адаптироваться к изменяющимся требованиям.

Связанные ресурсы

- Продукт LiteLLM

- LiteLLM Python SDK

- LiteLLM Gateway (Прокси)

- Документация

- Как начать путеводители

Как это работает (кратко)

- Расходы на ключ/пользователь/команда/орг и автоматическое отслеживание расходов между поставщиками.

- Обеспечить OpenAI-совместимый доступ с шлюзом, который обрабатывает маршрутизацию и наблюдаемость.

- Предлагайте ограждения, бюджеты и резервные механизмы для обеспечения надежного использования LLM с контролируемой стоимостью.