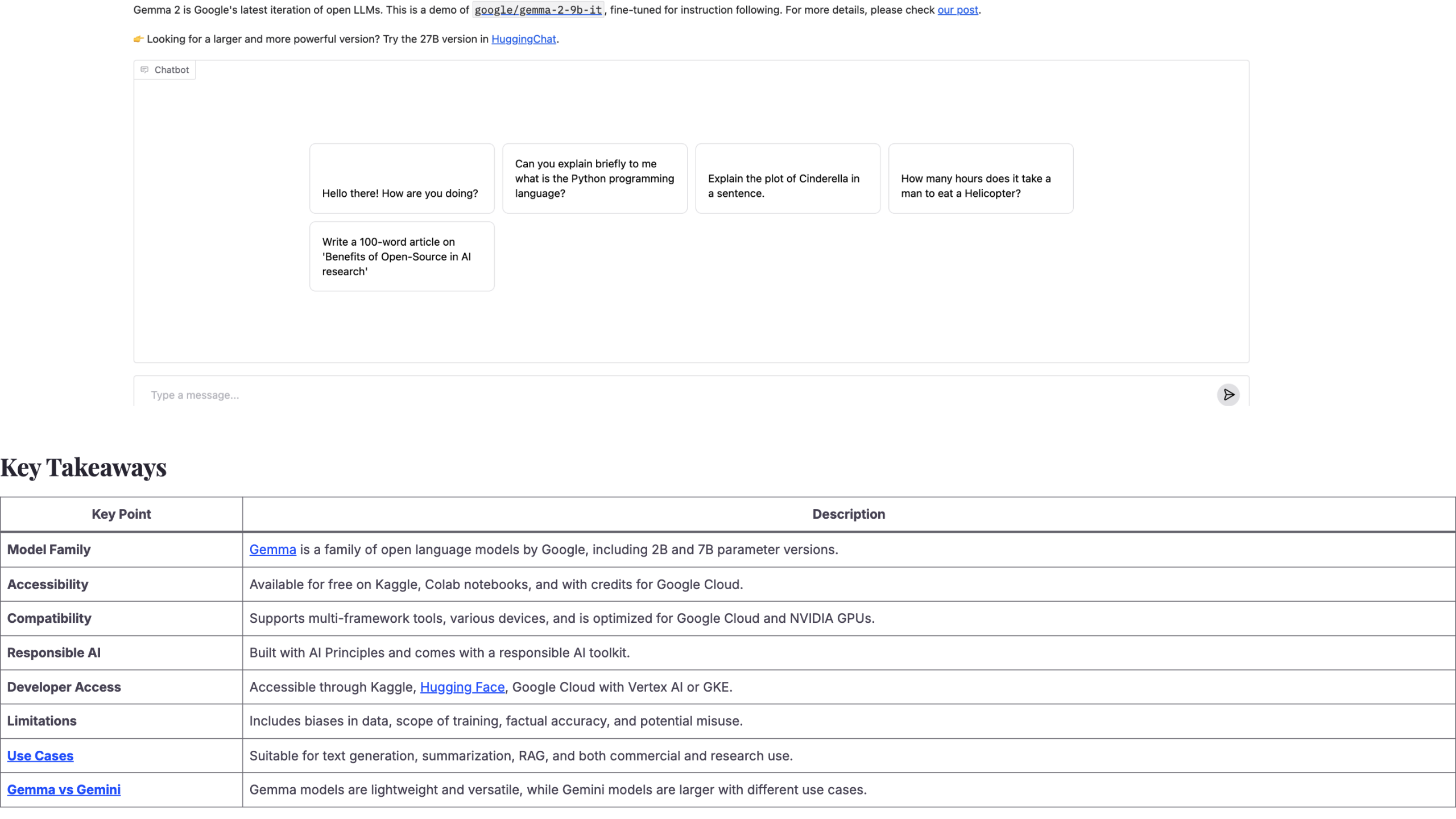

Google Джемма это семейство легких моделей открытого языка от Google, предназначенных для безопасного и надежного использования ИИ на устройствах и платформах. Доступный в размерах параметров 2B и 7B, Gemma предоставляет базовые (предварительно обученные) и настроенные на инструкции варианты и построен с использованием технологии масштаба Google, используемой в моделях Gemini. Он оптимизирован для совместимости между устройствами, развертывания Google Cloud и ускорения графического процессора NVIDIA. Модельное семейство подчеркивает доступность, ответственную практику ИИ и гибкую интеграцию для разработки и исследований.

Основные моменты

- Легкое открытое семейство LLM с параметрами 2B и 7B

- Доступные варианты настройки базы и инструкций

- Совместимость между устройствами: работает на ноутбуках, настольных компьютерах, устройствах IoT, мобильных устройствах и облаке

- Оптимизирован для Google Cloud (Vertex AI, GKE) и NVIDIA GPU

- Бесплатный доступ к Kaggle и Google Colab; кредиты доступны для Google Cloud

- Доступность через несколько экосистем (Kaggle, Colab, Google Cloud, Hugging Face)

- Ответственный инструментарий ИИ и четкое руководство по ограничениям и безопасному использованию

Как использовать Gemma

- Точки доступа: Kaggle, Google Colab, Google Cloud (Vertex AI или GKE), Hugging Face Inference Endpoints

- Варианты развертывания: использование в облачных рабочих процессах, локальных пограничных устройствах или локальных средах разработки

- Настройка: поддерживает базовые и настроенные на инструкции варианты; могут применяться методы тонкой настройки, такие как LoRA (при поддержке)

- Примеры использования: генерация текста, обобщение, RAG (поколение с расширением поиска), а также коммерческие и исследовательские задачи

Как это работает

- Выберите вариант Gemma (2B или 7B; базовый или настроенный на инструкции) на основе доступности ресурсов и потребностей в задачах.

- Запустите совместимое оборудование (ноутбуки, настольные компьютеры, IoT, мобильные или облачные графические процессоры).

- Интегрируйте через Kaggle, Colab, Vertex AI, GKE или Hugging Face конечные точки для вывода и экспериментов.

- Используйте предоставленный ответственный инструментарий ИИ для безопасного развертывания и управления использованием.

Доступ и развертывание экосистемы

- Kaggle: бесплатный доступ к моделям Gemma

- Google Colab: бесплатные и платные варианты с ресурсными кредитами

- Google Cloud: 300 долларов для новичков

- Vertex AI / GKE: развертывание и масштабируемое обучение

- Объятие лица: Интеграция конечных точек вывода для более широкой доступности

Ограничения и соображения

- Биазы и пробелы в данных обучения могут повлиять на результаты

- Сфера подготовки данных ограничивает экспертизу домена и современные знания

- Потенциал злоупотребления или проблемы конфиденциальности; ответственное использование и управление имеют важное значение

Основные характеристики

- Легкие модели с открытым языком (2B и 7B)

- Базовые и инструктированные варианты

- Совместимость между устройствами (ноутбуки, настольные компьютеры, IoT, мобильные устройства, облака)

- Оптимизирован для Google Cloud (Vertex AI, GKE) и NVIDIA GPU

- Бесплатный доступ к Kaggle и Google Colab; доступны кредиты Google Cloud

- Многоплатформенное развертывание через Kaggle, Colab, Vertex AI, Hugging Face

- Ответственный инструментарий ИИ и рекомендации по безопасному использованию