HyperMink AIТвой ИИ, твои правила

HyperMink AI стремится демистифицировать ИИ для повседневных пользователей, уделяя приоритетное внимание доступности и конфиденциальности. Платформа подчеркивает, что ИИ должен быть понятным и доступным, устраняя запугивание и сложность из пользовательского опыта. Он позиционирует себя как ориентированную на пользователя экосистему, где люди могут взаимодействовать с ИИ без необходимости глубоких технических знаний.

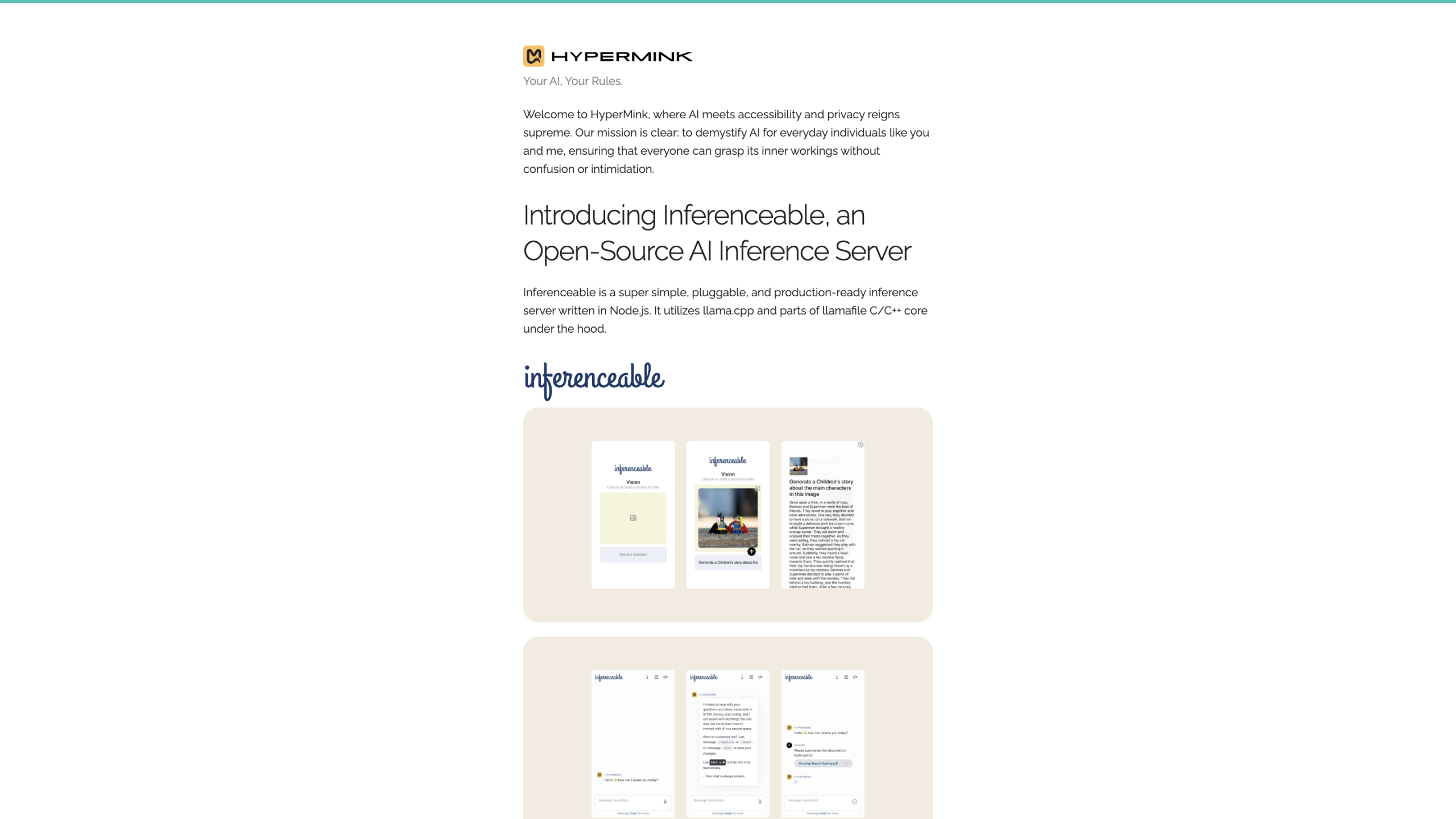

Inferenceable: Open-Source AI Inference Server

Inferenceable — это сервер вывода с открытым исходным кодом, готовый к производству, предназначенный для супер простого, подключаемого и легкого развертывания. Построенный с помощью Node.js, он использует производительность llama.cpp и компонентов из ядра llamafile C / C++ для обеспечения эффективного вывода модели ИИ.

Ключевые атрибуты

- Открытый исходный код и сообщество: Прозрачная разработка с акцентом на доступность для разработчиков и исследователей.

- Готовое к производству: предназначено для развертывания в реальном мире, а не только для экспериментов.

- Взаимозаменяемая архитектура: Легко расширяемая с новыми моделями, временем выполнения и интеграцией.

- Реализация Node.js: Согласуется с общими стеками веб-разработки для более простой интеграции в существующие приложения.

- Под питанием капота: использует llama.cpp и части llamafile для оптимизации производительности вывода.

- Доступность GitHub: Исходный код и сотрудничество облегчаются через общедоступный репозиторий.

Как работают бессмысленные

- Легкий модульный сервер: Inferenceable работает как сервис Node.js, который может быть интегрирован в существующие бэкэнды или развернут отдельно.

- Модельный вывод с использованием llama.cpp: Сервер использует компоненты на основе llama.cpp для выполнения эффективных выводов на основе модели большого языка.

- Взаимозаменяемые компоненты: Заменяйте или расширяйте модели, время выполнения и инструменты без капитального ремонта всей системы.

- Готовые к производству функции: Сосредоточьтесь на надежности, масштабируемости и ремонтопригодности для реальных случаев использования.

Безопасность, конфиденциальность и соблюдение

- Конфиденциальность по дизайну: способность настраивать и контролировать поток данных с учетом ответственного использования ИИ.

- Прозрачность с открытым исходным кодом: надзор сообщества помогает улучшить безопасность и управление.

- Четкое руководство по использованию: поощряет ответственное развертывание и раскрытие возможностей и ограничений модели.

Основные характеристики

- Открытый сервер вывода ИИ с интерфейсом Node.js

- Простая, подключаемая архитектура для простого расширения

- Готовый к производству дизайн, подходящий для развертывания

- Использование компонентов llama.cpp и llamafile C/C++ для эффективного вывода

- Сообщество с исходным кодом, размещенным на GitHub

- Гибкие варианты развертывания и интеграция с существующими системами