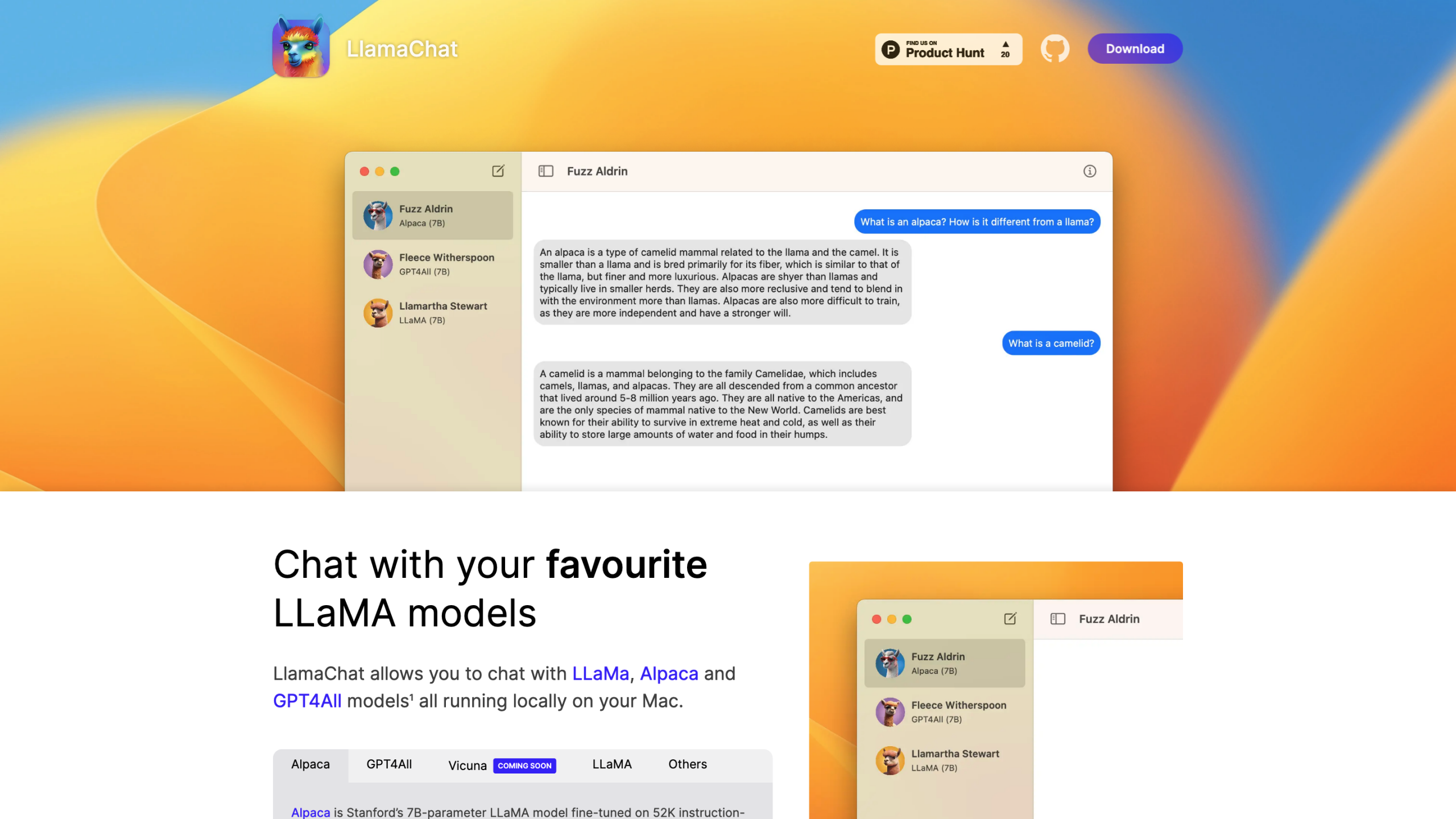

LlamaChat — это локальное чат-приложение для macOS, которое позволяет вам взаимодействовать с моделями семейства LLaMA с открытым исходным кодом (LLaMA, Alpaca, Vicuna, GPT4All и т. Д.) непосредственно на вашем Mac. Он поддерживает импорт необработанных контрольных точек модели PyTorch или предварительно преобразованных файлов модели .ggml, работающих полностью в автономном режиме без облачной зависимости. Проект подчеркивает доступность с открытым исходным кодом, совместимость моделей и локальную обработку.

Как использовать LlamaChat

- Установить на macOS. Скачать приложение или установить через Homebrew:

brew install --cask llamachat(требуется macOS 13 и совместимый процессор). - Выберите модель. Выберите из доступных локально представленных моделей (например, LLaMA, Alpaca, Vicuna, GPT4All), которые вы интегрировали или импортировали.

- Импорт файлов моделей. Импорт сырых опубликованных контрольных точек PyTorch или предварительно преобразованных файлов модели .ggml в LlamaChat.

- Чат локально. Начните общаться с выбранной моделью непосредственно на вашем Mac.

Примечание: LlamaChat по умолчанию не содержит никаких типовых файлов. Вы несете ответственность за приобретение и интеграцию соответствующих типовых файлов в соответствии с условиями каждого поставщика.

Особенности

- Первый локальный чат с моделями семейства LLaMA (LLaMA, Alpaca, Vicuna, GPT4All и другие)

- Поддержка импорта необработанных контрольных точек PyTorch и файлов моделей .ggml

- Полностью открытый исходный код (llama.cpp и llama.swift)

- Кросс-процессорная совместимость (Apple Silicon и Intel; macOS 13+)

- Независимо от партнерских отношений с поставщиками моделей или облачных сервисов

- Четкое лицензирование и атрибуция моделей, используемых

Как это работает

- LlamaChat использует библиотеки с открытым исходным кодом (llama.cpp, llama.swift) для локального запуска больших языковых моделей.

- Пользователи приносят свои собственные файлы моделей; приложение предоставляет пользовательский интерфейс для загрузки и взаимодействия с этими моделями.

- Программное обеспечение на 100% бесплатное и с открытым исходным кодом, с постоянным вкладом сообщества.

Безопасность и правовые соображения

- Вы несете ответственность за получение и использование моделей в соответствии с их лицензиями и условиями.

- В качестве независимого приложения LlamaChat не связан с Meta Platforms, Stanford, Nomic AI или другими организациями, упомянутыми в заметках проекта.

Основные характеристики

- Локальное, автономное исполнение моделей семейства LLaMA на macOS

- Импорт контрольных точек PyTorch и файлов моделей .ggml

- Открытый исходный код, свободно доступный по лицензиям проекта

- Совместимость с Apple Silicon и Intel Mac (macOS 13+)

- Никаких моделей в комплекте; только модели, предоставляемые пользователями

- Простая, самодостаточная установка с общинным развитием