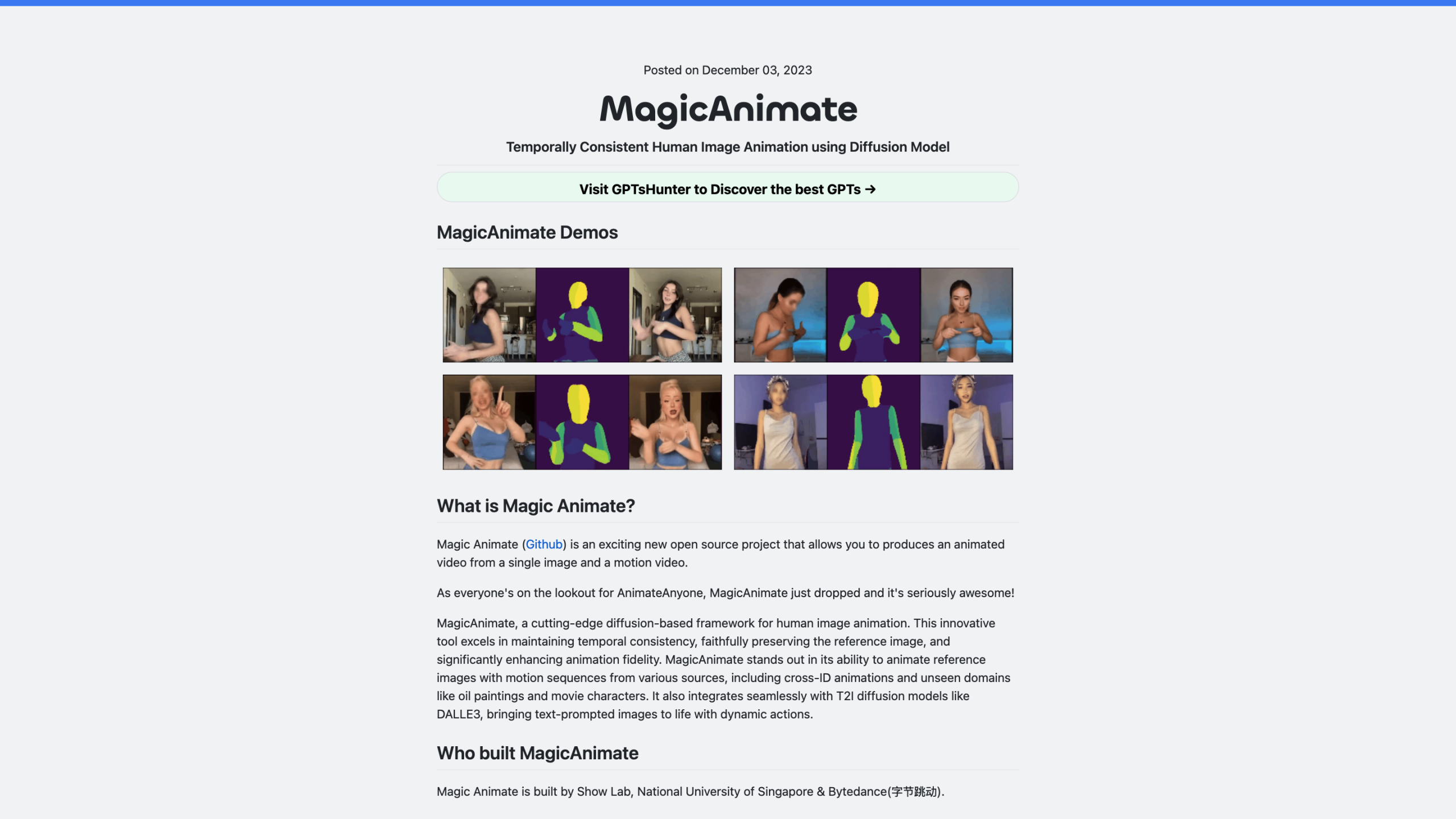

MagicAnimate: временная согласованная анимация изображения человека с использованием модели диффузии

MagicAnimate — это фреймворк на основе диффузии с открытым исходным кодом, который превращает одно изображение в анимированное видео, управляемое видео движения или данными позы. Он подчеркивает временную согласованность, верное сохранение эталонного изображения и высокую точность анимации. Он поддерживает анимацию эталонных изображений с последовательностями движения из различных источников, включая кросс-ID-анимации и невидимые домены, такие как картины маслом и персонажи фильмов. Он также интегрируется с моделями диффузии текста к изображению (например, DALLE3), чтобы воплотить в жизнь текстовые концепции в виде динамических действий.

Что это такое

- Передовой инструмент, разработанный Show Lab, Национальным университетом Сингапура и Bytedance, который позволяет анимировать статическое изображение с помощью ввода движения.

- Диффузионно-модельный трубопровод, ориентированный на поддержание временной когерентности между кадрами при сохранении эталонной идентичности.

- Совместим с различными источниками движения (видео, ключевые точки, данные OpenPose) и способен стилизовать выходы в соответствии с различными областями или эстетикой.

Начало работы

- Предпосылки: Python >= 3.8, CUDA >= 11.3, FFmpeg

- Установка (конда):

- conda env create -f environment.yml

- активировать manimate

- Модели: загрузите предварительно подготовленные базовые модели для стабильной диффузии v1.5 и MSE-finetuned VAE, а также контрольные точки MagicAnimate

- Онлайн-демо: Попробуйте MagicAnimate на HuggingFace, Replicate, Colab или других предоставленных демо-ссылках

- Доступ к API: репликация API, доступная для создания анимированных видео

Как это работает (высокий уровень)

- Начните с одного эталонного изображения и видео движения (или данных о позе)

- Используйте генерацию на основе диффузии для распространения сигналов движения по кадрам, при этом ограничивая выход, чтобы он напоминал исходную ссылку

- Необязательно: преобразуйте входное движение в ключевые точки OpenPose для управления анимацией

- Поддержка рабочих процессов на основе OpenPose с помощью интеграционных моделей (магическое-животное-открытое) и извлечения движения на основе OpenPose

Как генерировать анимацию

- Подготовьте входные данные: справочное изображение и видео движения или данные о позе

- Базовые модели нагрузки и контрольные точки

- Запустите аниматор на основе диффузии с соответствующими параметрами (num inference steps, guidance scale, seed)

- Экспорт полученного анимированного видео

Платформы и демо

- Примеры реплицирования API: запустите магические модели с входами, включая изображение, видео движения и параметры вывода

- Обнимать Демоверсии Face и Colab доступны для быстрых экспериментов

Ограничения и советы

- Искажение может произойти в лицах и руках в некоторых выходных данных; может потребоваться настройка контрольных точек

- Конфигурация по умолчанию может изменить стиль (например, от аниме до реализма) в зависимости от трубопровода, управляемого DensePose; настройте контрольную точку, чтобы изменить стиль

- Стиль аниме может изменять пропорции тела из-за поведения базовой модели; рассмотреть корректировки модели для желаемой эстетики

- Рабочие процессы на основе OpenPose существуют для преобразования потоков движения в совместимые данные руководства

Безопасность и этика

- Использование ответственно: уважать конфиденциальность и согласие при анимации отдельных лиц или общественных деятелей; избегать искажений или случаев вредного использования

Как использовать MagicAnimate

- Установите зависимости и загрузите необходимые модели

- Подготовить изображение и ввод движения

- Запустите конвейер анимации с выбранными параметрами

- Восстановление сгенерированного анимированного видео

Случаи использования

- Анимационные портреты или персонажи из фильмов, игр или произведений искусства

- Создание стилизованных видео движения из статических изображений

- Исследуйте междоменную анимацию (например, приведите движение к картинам маслом)

Соображения

- Вычислительно интенсивный; требует ускорения GPU

- Качество зависит от типовых контрольных точек и качества входных данных

Основные характеристики

- Временно согласованная анимация изображения человека с использованием моделей диффузии

- Поддерживает ввод движения из видео, данные о позе (OpenPose) и текстовые подсказки

- Высокая точность сохранения эталонного изображения/идентичности

- Междоменные возможности анимации (например, картины маслом, персонажи фильмов)

- Интеграция с контрольными точками Stable Diffusion v1.5 и MSE-finetuned VAE

- Открытый исходный код с онлайн-демо (HuggingFace, Replicate, Colab)

- Доступ к API через Replicate для программного использования

- Поддержка рабочего процесса OpenPose через выделенные модели (магическое-одушевленное-открытое)

- Настраиваемый с помощью шагов вывода, шкалы наведения и семян для контроля точности и вариации