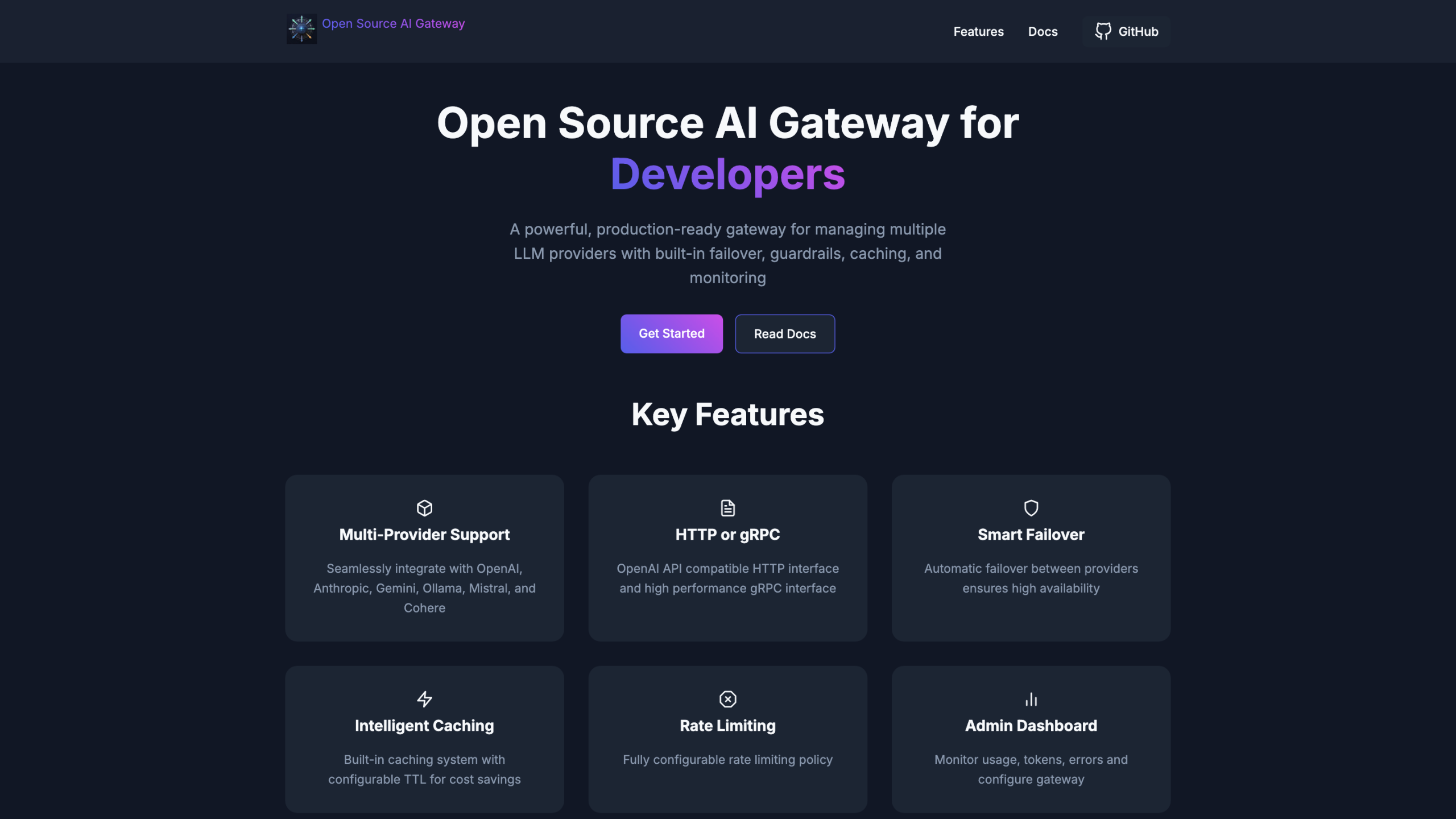

AI Gateway с открытым исходным кодом — это готовый к производству шлюз, который управляет несколькими поставщиками LLM со встроенным отказоустойчивостью, ограждениями, кэшированием и мониторингом. Он поддерживает интеграцию с несколькими провайдерами (OpenAI, Anthropic, Gemini, Ollama, Mistral, Cohere) и предоставляет интерфейсы HTTP или gRPC, совместимые с API OpenAI.

Ключевые особенности

- Поддержка нескольких провайдеров: бесшовная интеграция с OpenAI, Anthropic, Gemini, Ollama, Mistral и Cohere для гибкого выбора и резервирования провайдеров

- HTTP или gRPC интерфейсы: OpenAI API-совместимый HTTP интерфейс и высокопроизводительный gRPC интерфейс

- Умный отказ: автоматический отказ между поставщиками для обеспечения высокой доступности

- Интеллектуальное кэширование: встроенное кэширование с настраиваемым TTL для экономии затрат и более быстрого реагирования

- Ограничение ставок: Полностью настраиваемые политики ограничения ставок для защиты бэкэндов

- Admin Dashboard: мониторинг использования, токенов, ошибок и настройки шлюза

- Охрана содержимого: Настраиваемая фильтрация содержимого и меры безопасности

- Интеграция с Splunk, Datadog и Elasticsearch для централизованного наблюдения

- Система быстрого впрыска: перехват и впрыск системы подсказки для всех исходящих запросов

Начало работы

- Конфигурировать

- Создание файла Config.toml с конфигурацией API

- Пример сниппета:

[openAIConfig]

apiKey — «Твой ключ»

модель = «gpt-4»

конечная точка =https://api.openai.com«

- Беги

- Запустите контейнер с установленной конфигурацией:

docker run -p 8080:8080 -p 8081:8081 — p 8082:8082

-v $(pwd)/Config.toml:/home/ballerina/Config.toml

chintana/ai-gateway:v1.2.0

- Использовать

- Пример запроса:

кёрл — X POST http://localhost:8080/v1/chat/completions

-H «Контент-тип: приложение/json»

-H «x-llm-provider: openai»

-d {«сообщения»: [{«роль»: «пользователь», «содержание»: «Когда у нас будет ОИИ?» В 10 словах «}]

Как это работает

- Создайте конфигурацию шлюза для подключения к нескольким провайдерам LLM.

- Шлюз направляет запросы к настроенному провайдеру(ам) через HTTP или gRPC.

- Встроенный отказоустойчивый автоматически переключается на здорового поставщика, если он не справляется.

- Слой кэширования сохраняет частые ответы для снижения затрат и задержки.

- Панель управления администратором обеспечивает видимость токенов, использования и показателей ошибок.

- Системные подсказки могут быть введены или изменены для всех исходящих запросов.

- Ограждения и фильтрация контента помогают обеспечить безопасность и соблюдение политики.

- Интеграция систем регистрации предприятий позволяет осуществлять централизованный мониторинг и наблюдение.

Безопасность и соблюдение

- Используйте ответственные конфигурации для ограничения скорости, ограждения и мониторинга для предотвращения неправильного использования и обеспечения надежности.

Основные компоненты

- Gateway Runtime с многопрофильной оркестровкой

- Слой кэширования для оптимизации ответа

- Ограждения и модуль фильтрации содержимого

- Административная панель приборов и интеграция видимости

- Система быстрого впрыска