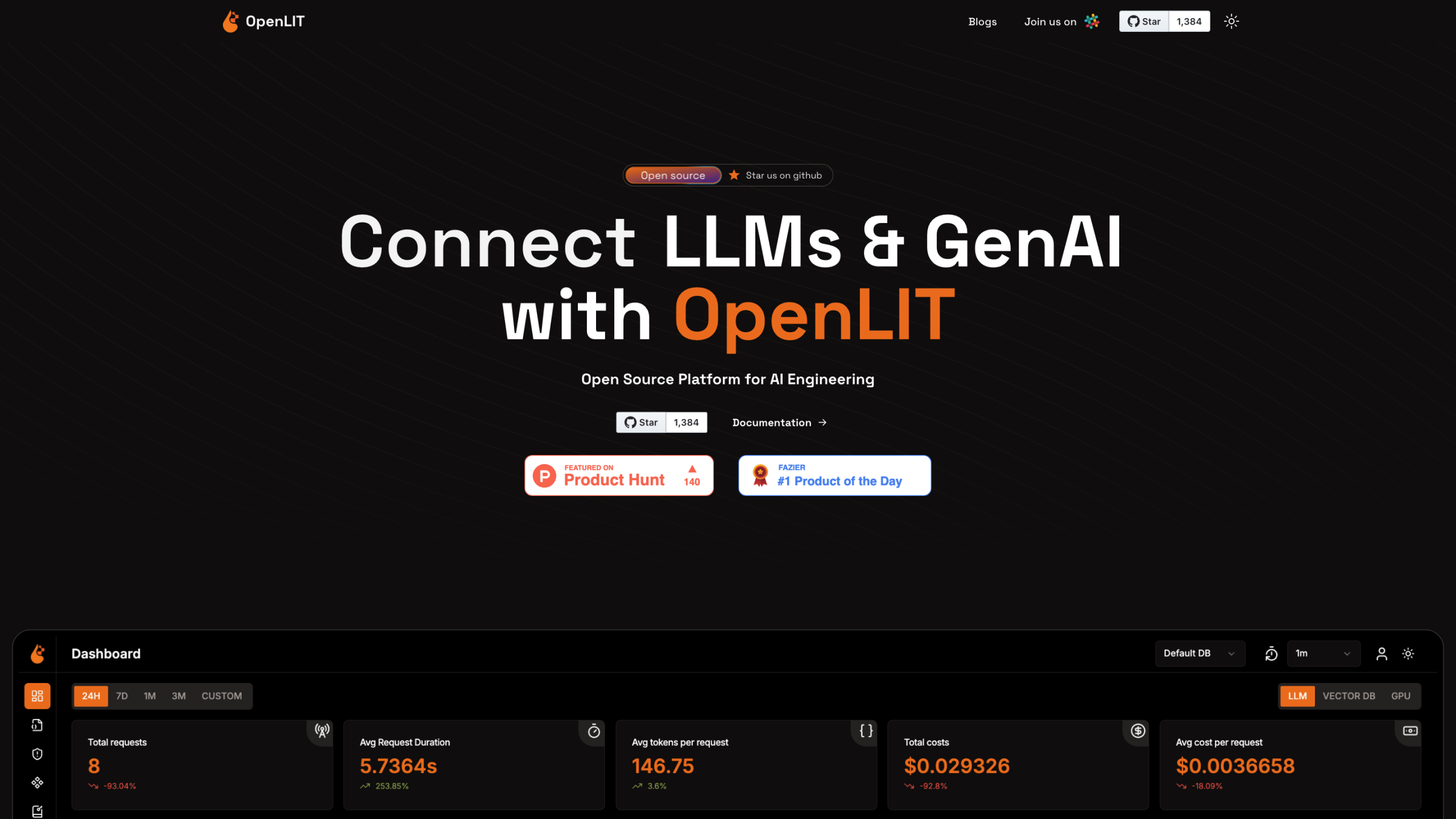

<# OpenLIT: OpenTelemetry-native GenAI and LLM Application Observability #>

OpenLIT — это платформа с открытым исходным кодом, предназначенная для приложений GenAI и LLM. Он помогает понять, контролировать и оптимизировать рабочие нагрузки на основе ИИ, обеспечивая сквозное отслеживание, мониторинг исключений, анализ затрат, оперативное управление, секретное управление и бесшовную интеграцию с OpenTelemetry. Он поддерживает локальный запуск (docker-compose) и может быть размещен самостоятельно, предлагая прозрачность в том, что делает ваш код и как он работает в разных провайдерах и моделях.

Что дает OpenLIT

- Сквозное отслеживание запросов между различными поставщиками для улучшения видимости производительности

- Детальное отслеживание интервалов времени отклика и эффективности

- OpenTelemetry-native инструментарий для приложений ИИ

- Отслеживание расходов и подробная отчетность для содействия бюджетированию и принятию решений

- Автоматический мониторинг исключений и подробные следы стека для диагностики проблем

- Интеграция со следами для захвата исключений в потоках запросов

- Игровая площадка для сравнения LLM бок о бок по производительности, стоимости и показателям

- Централизованное оперативное хранилище с версиями и динамическими переменными

- Управление секретами (Vault Hub) с безопасным хранением, доступом и интеграцией среды

- Простая в использовании интеграция SDK для Python и TypeScript

- Поток данных в реальном времени для быстрой визуализации и принятия решений

- Интеграция платформ наблюдения (Datadog, Grafana Cloud и др.)

- Открытый исходный код: легкая абордаж с докер-композитом и возможностями самохостинга

Как использовать OpenLIT

- Запуск локально с Docker:

- docker-compose up -d

- Инициируйте клиент OpenLIT в своем проекте:

- Добавьте openlit.init(), чтобы начать сбор данных из вашего приложения LLM

- Применяйте свой код для испускания следов, метрик и журналов с помощью механизмов, совместимых с OpenTelemetry

- Исследуйте:

- Сравнение LLM в OpenLIT PlayGround

- Панели анализа затрат и подробные отчеты

- Централизованное управление подсказками и секретами

- Подключитесь к своим любимым инструментам наблюдения (Datadog, Grafana Cloud) для экспорта и визуализации

Основные характеристики

- Сквозное отслеживание запросов между поставщиками LLM через OpenTelemetry

- Подробное отслеживание охвата для анализа производительности и эффективности

- Автоматический мониторинг исключений с подробными следами стека

- Сравнение LLM в PlayGround (производительность, стоимость, метрики)

- Централизованное оперативное хранилище с редактированием и динамическим замещением переменных

- Управление секретами через Vault Hub с безопасным хранением и интеграцией среды

- Секретный доступ и безопасное управление ключами

- Поток данных в реальном времени для немедленной видимости рабочих нагрузок ИИ

- Интеграция OpenTelemetry для бесшовных приборов

- Анализ затрат и всеобъемлющая отчетность для оптимизации бюджета

- Легкая посадка на борт: решение с самообслуживанием с докер-композитом

- Интеграция платформ наблюдения для экспорта в Datadog, Grafana Cloud и др.

Как это работает

- Применяйте приложения LLM с помощью OpenTelemetry и OpenLIT SDK (Python/TypeScript)

- Собирайте следы, метрики, журналы и секреты, чтобы получить полную наблюдаемость в моделях, подсказках и вызовах

- Используйте PlayGround для сравнения моделей по производительности и стоимости в реальном времени

- Храните подсказки и секреты надежно; заменяйте переменные во время выполнения

- Экспорт данных в ваш предпочтительный стек наблюдения для приборных панелей и предупреждений

Безопасность и конфиденциальность

- OpenLIT — это инструмент с открытым исходным кодом, предназначенный для прозрачности; убедитесь, что вы не регистрируете конфиденциальные данные в трассах или подсказках

- Используйте Vault Hub и безопасную обработку среды для защиты учетных данных и ключей API

- Следуйте передовым методам минимизации данных и контроля доступа при использовании ваших приложений

Начало быстрой ссылки

- Начать локально: docker-compose up -d

- Инициализируйте: openlit.init() в вашем приложении

- Инструмент: добавьте отслеживание и метрики через OpenLIT / OpenTelemetry

- Анализ: используйте PlayGround и отчеты о затратах для оптимизации

- Secure: управление секретами с помощью Vault Hub и переменных среды

Целевая аудитория

- Инженеры ИИ и команды MLOps создают приложения на базе GenAI / LLM

- Команды, нуждающиеся в сквозной видимости, контроле затрат и надежности для рабочих нагрузок ИИ

- Энтузиасты с открытым исходным кодом ищут прозрачное, самостоятельно размещенное решение для наблюдения