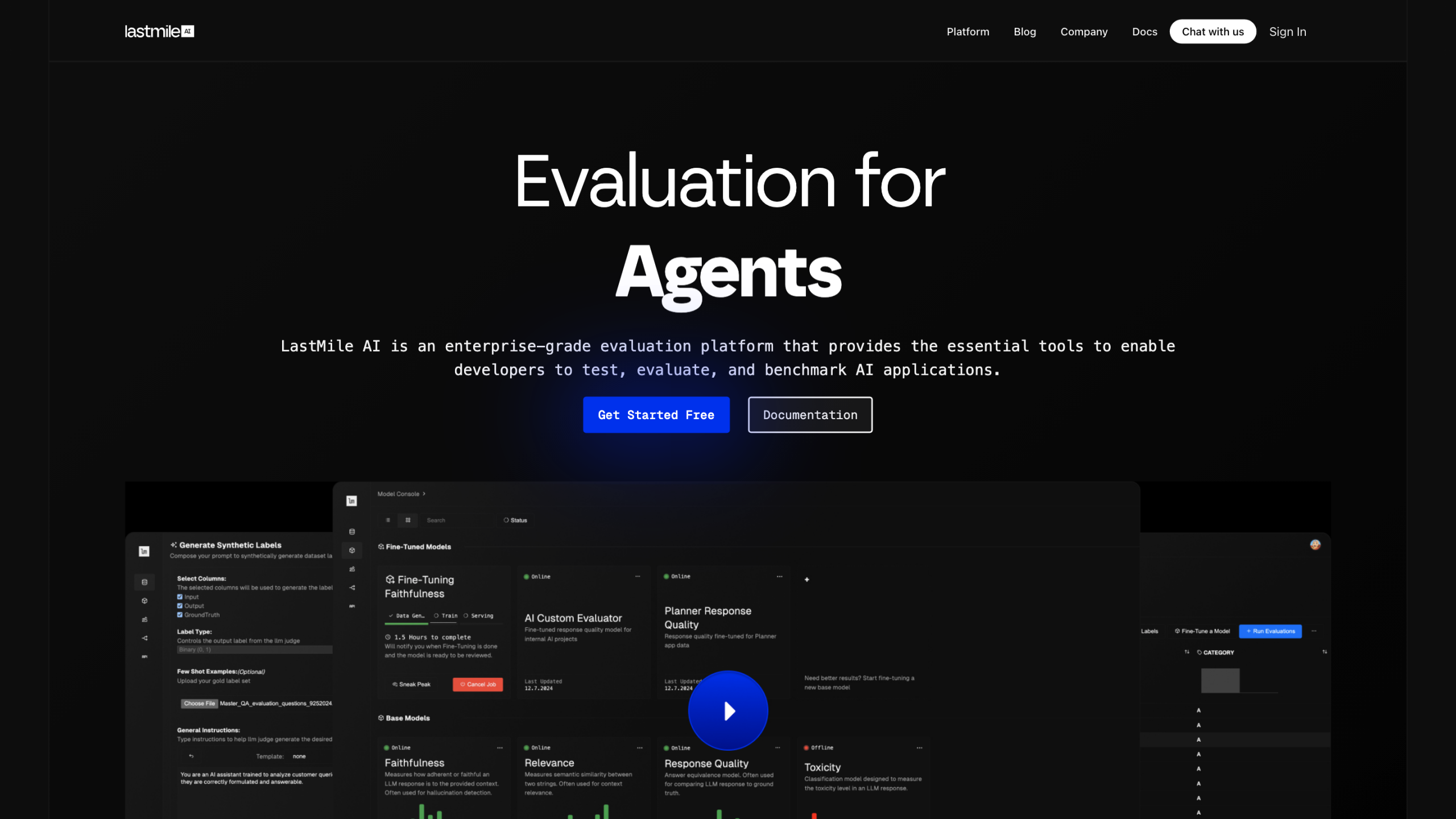

LastMile AI AutoEval — платформа для оценки искусственного интеллекта это платформа корпоративного уровня, предназначенная для того, чтобы помочь разработчикам тестировать, оценивать и тестировать приложения ИИ. Он поставляется с метриками оценки, включенными в батарею, для RAG и мультиагентного ИИ, а также возможностями тонкой настройки для разработки пользовательских оценщиков. Платформа подчеркивает воспроизводимость, частное развертывание и оценку в реальном времени в масштабе.

Как это работает

- Установка и интеграция: быстрый запуск с примерами кода для Python и TypeScript.

- Используйте встроенные метрики или собственные пользовательские оценщики, чтобы измерить, насколько хорошо ваша система ИИ выполняет реальные задачи.

- Оценщики тонкой настройки: модели оценки поездов, адаптированные к вашим критериям распределения и оценки данных.

- Запустите AutoEval в частном виртуальном облаке или в собственной инфраструктуре с надежным управлением данными.

- Мониторинг в реальном времени: вывод в реальном времени, ограждения и постоянный мониторинг надежности производственного уровня.

Основные способности

- AutoEval Out-of-the-Box Metrics для RAG и мультиагентных приложений ИИ

- Сервис тонкой настройки для разработки собственных оценщиков

- Оценка ИИ в реальном времени с пылающим быстрым выводом

- Частные варианты развертывания (Private VPC / On-Prem) для обеспечения безопасности и соответствия

- Генерация синтетических данных для автоматизации маркировки и сокращения ручного усилия

- Управление воспроизводимыми экспериментами для ускорения инноваций

- Пользовательские метрики поддерживают улавливание нюансированных критериев оценки

- Ограждения и активный мониторинг для выявления аномалий и снижения рисков

- Кросс-языковые примеры клиентов (Python и TypeScript) для простой интеграции

- Масштабируемая оценка и крупномасштабная поддержка данных

Как использовать AutoEval

-

Python example (pip install lastmile):

-

от lastmile.lib.auto eval импорт AutoEval, BuiltinMetrics

-

клиент = AutoEval()

-

результат = client.evaluate data

data=pd.DataFrame({«input»: [«Где вырос автор?»],

«выход»: [«Франция»],

«ground truth»: [«Англия»]],

метрики = [BuiltinMetrics.FAITHFULNESS]

) -

Пример TypeScript:

-

const { AutoEval, BuiltinMetrics } = require(«lastmile/lib/auto_eval»);

-

const client = await AutoEval.create();

-

результат const = ожидайте клиент.evaluateData

данные: [{ввод: «Где вырос автор?», вывод: «Франция», ground truth: «Англия»],

метрики: [BuiltinMetrics. Верность

}; -

Пользовательские метрики: загрузите данные приложения, определите свои собственные модели оценки и настройте по мере необходимости.

Особенности Highlights

- Метрики вне коробки для оценки RAG и мультиагентных систем

- Точная настройка моделей оценки в соответствии с конкретными критериями приложения

- Оценка в режиме реального времени с выводом ультранизкой задержки

- Частные варианты развертывания для контроля данных и соблюдения нормативных требований

- Синтетическая генерация данных для автоматизации маркировки и создания данных

- Воспроизводимое управление экспериментом для получения надежных результатов

- Пользовательские метрики и поддержка пользовательских оценщиков для индивидуальных потребностей

- Охранные рельсы и постоянный мониторинг для активного управления рисками

- Межъязыковые SDK (Python и TypeScript) для бесшовной интеграции

- Масштабируемые рабочие процессы оценки с поддержкой больших наборов данных

Почему стоит выбрать AutoEval

- Надежный, готовый к производству инструмент оценки, предназначенный для реальных систем ИИ

- Сквозной рабочий процесс от генерации данных до оценки и мониторинга

- Гибкие модели развертывания для удовлетворения требований безопасности, конфиденциальности и соответствия предприятия

- Ускорение инноваций ИИ за счет сокращения ручной маркировки и ускорения экспериментов

Вопросы безопасности и развертывания

- Развертывание в вашем собственном частном облаке или локально для поддержания суверенитета данных

- Использование синтетической генерации данных для минимизации воздействия конфиденциальной информации

- Внедрение защитных ограждений для выявления и смягчения рискованного поведения моделей в производстве

Быстрые стартовые ресурсы

- Официальная документация и руководства API

- Примеры и учебные пособия для AutoEval на Python и TypeScript

- Ценовые уровни, включая бесплатный вход для быстрых экспериментов