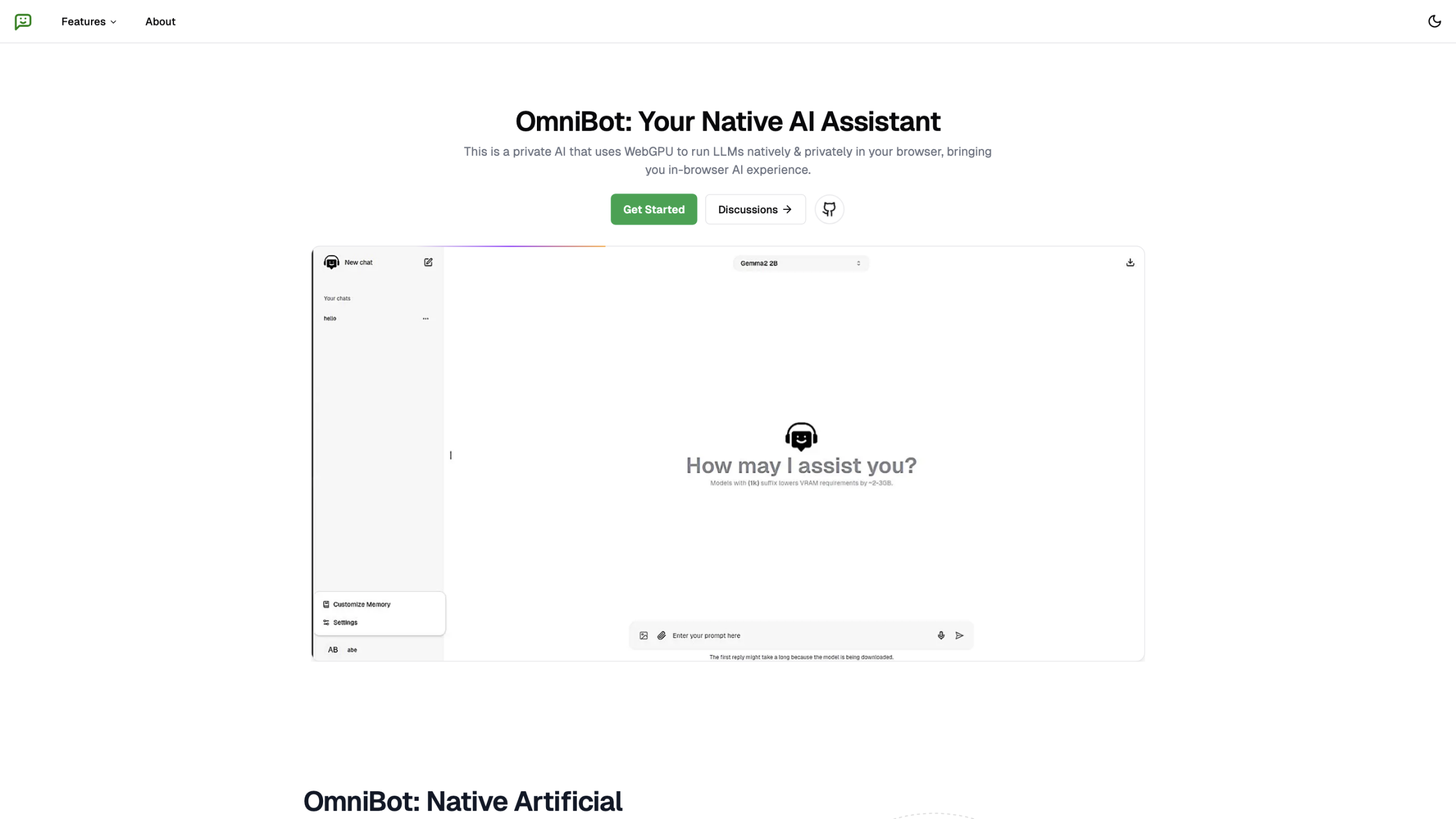

OmniBot — это частный помощник ИИ в браузере, который запускает большие языковые модели локально в вашем браузере с помощью WebGPU. Он обеспечивает автономный, ориентированный на конфиденциальность опыт ИИ, где все вычисления ИИ происходят на устройстве пользователя, без отправки данных на внешние серверы. Платформа подчеркивает встроенную интеграцию, пользовательскую память и автономные возможности, позволяя пользователям взаимодействовать с моделями ИИ непосредственно в браузере и даже без подключения к Интернету после первоначальной загрузки модели.

Основные моменты:

- В браузере, автономный ИИ: все модели ИИ работают локально на оборудовании пользователя для конфиденциальности и автономного использования.

- Работает на WebGPU: использует аппаратное ускорение с поддержкой WebGPU для эффективного запуска LLM в браузере.

- Пользовательская память: возможность добавлять пользовательские инструкции или память для персонализации ответов.

- Технический стек: построен на высокопроизводительных фреймворках и инструментах, включая Hugging Face, LangChain, WebLLM, TypeScript, Next.js и многоязычные модели ИИ с открытым исходным кодом.

- Требование к GPU: рекомендует GPU с достаточной памятью (например, 6 ГБ для моделей 7B, 3 ГБ для моделей 3B).

- Доступность: поддерживает автономный чат после загрузки модели; мобильные устройства с поддержкой WebGL могут использовать OmniBot аналогично ПК.

- Форматы вывода: генерирует и сохраняет сообщения чата в форматах JSON или Markdown.

Как работает OmniBot

- Загрузка модели: Пользователи загружают модель один раз, чтобы включить автономное использование.

- Локальный вывод: Все последующие выводы LLM выполняются локально в браузере на устройстве пользователя.

- Персонализация: поддержка пользовательской памяти позволяет адаптировать ответы к предпочтениям пользователя.

- Совместимость: использует LangChain и другие фреймворки для интеграции LLM в приложения.

Что можно сделать с OmniBot

- В браузере ИИ беседы без сервера туда-обратно

- Операция в автономном режиме после первоначальной загрузки модели

- Настраиваемая память и инструкции для персонализированного взаимодействия

- Поддержка многоязычных моделей и компоненты с открытым исходным кодом

- Создание и сохранение транскриптов чата в JSON или Markdown

Безопасность и требования

- Требуется совместимый GPU и достаточно оперативной памяти для выбранного размера модели.

- Конфиденциальность: данные, обрабатываемые локально; отсутствие серверного хранилища данных для взаимодействия с ИИ.

Как использовать OmniBot

- Проверьте совместимость и требования к оборудованию.

- Загрузите поддерживаемую модель (например, варианты 7B или 3B).

- Используйте OmniBot в своем браузере с поддержкой WebGPU; включите автономное использование после загрузки.

- Необязательно: Добавьте пользовательскую память / инструкции для персонализированных ответов.

- Сохраните чаты как JSON или Markdown.

Что включено

- In-browser, автономный вывод LLM с использованием WebGPU

- Локальная обработка данных для конфиденциальности

- Пользовательская память и поддержка инструкций

- Многоязычная модель экосистемы с открытым исходным кодом

- Next.js-интерфейс с TypeScript

- Интеграция через LangChain и связанные с ним инструменты

- Руководство по производительности с GPU (6 ГБ для 7B, 3 ГБ для 3B моделей)

- Экспорт JSON/Markdown транскриптов чата